So verändert und spaltet uns Technik – Eine Welt voller Extreme

Filterblasen und Radikalisierung - Technologie wird uns für immer verändern

Das Internet und Social-Media-Plattformen haben einen großen Einfluss auf unser Leben und sie können uns sogar in vielerlei Hinsicht verändern und spalten. Was sind Vorurteile, Filterblasen und warum versuchen Social-Media-Plattformen, uns zu spalten?

Die Technologie kann als ein Wunder der modernen Zeit angesehen werden, aber trennt sie uns auch gesellschaftlich? Vor nicht einmal zwei Jahrhunderten konnten wir uns nicht einmal vorstellen, dass wir fliegen können, es gab keine Möglichkeit, jemanden anzurufen oder gar eine Videokonferenz zu halten, bei der man gleichzeitig ein Dokument teilt. Der Computer und das Internet haben viele Auswirkungen auf unser tägliches Leben gehabt und wir spüren jetzt die Auswirkungen auf unsere Gesellschaft und uns selbst.

Das Internet ermöglichte es uns, uns über Social-Media-Plattformen zu verbinden, auszutauschen und zu interagieren, online nach Informationen zu suchen und Inhalte ohne Grenzen zu konsumieren. In gewisser Weise hat es unsere soziale Interaktion auf eine ganz neue Art und Weise beschleunigt. Wir haben uns daran gewöhnt, grenzenlos durch die virtuelle Welt zu scrollen, zu browsen, zu swipen und zu tippen, mit unendlichen Inhalten, die von Menschen erzeugt werden, die wir lieben, bewundern, verehren oder sogar beneiden.

Aber all diese Verbindungen, Möglichkeiten und die Fülle an Informationen haben auch Konsequenzen. Wir sind extrem, wenn es um die Wahl unserer Partner geht, denn Apps wie Tinder vermitteln uns den Eindruck, dass es nur einen Wisch weiter ein noch besseres Match gibt, Instagram gaukelt uns eine perfekte Welt vor, in der die Menschen nur glücklich, reich und erfolgreich sind und Filter vermitteln uns den Eindruck, dass nur ein perfekt aussehendes Gesicht/Körper/Urlaub die Norm ist. Wir werden mit Fake News bombardiert, wir sind in einer Welt gefangen, in der wir nur die Inhalte sehen, die am besten zu uns passen und wir werden sogar nur mit Menschen verbunden, die ein Algorithmus für uns auswählt.

Diese Folgen führen auch zu einer Spaltung in unserer Gesellschaft.

Index

Das Problem mit sozialen Medien

Um das grundlegende Dilemma der sozialen Medien zu verstehen, müssen wir die Mechanik dahinter und ihr Geschäftsmodell verstehen. Zuallererst müssen wir verstehen – die Nutzer sind das Produkt. Jeder, der Plattformen wie Facebook, Twitter, etc. nutzt, stimmt zu, analysiert zu werden und Werbung zu sehen. Daher versuchen die Plattformen, die Zeit, die Sie auf der Plattform verbringen, zu maximieren, indem sie Manipulationstechniken einsetzen, die in Ihrem Gehirn Ängste erzeugen, damit Sie länger auf der Plattform bleiben und mehr Inhalte konsumieren, damit sie Ihnen mehr Werbung zeigen können.

Die Hauptziele für Social-Media-Plattformen sind:

- Die meisten Informationen über einen Benutzer, sein Leben, seinen Lebensstandard, sein Umfeld etc. zu sammeln

- Den Benutzer dazu bringen mehr Inhalte zu teilen

- Den Benutzer dazu bringen mehr Inhalte zu konsumieren

- Den Benutzer dazu bringen mit anderen Inhalten zu interagieren

- Den Benutzer dazu bringen weitere Benutzer einzuladen

- Den Benutzer dazu bringen mit Werbung zu interagieren

- Mehr Markenbekanntheit erreichen

Zweitens müssen wir verstehen, dass der einzige wirkliche Kunde von Social-Media-Plattformen die zahlenden Werbekunden sind. Alle Social-Media-Plattformen versuchen, ihre Ergebnisse zu optimieren. Ihre Daten, Ihre Zeit und Ihre Interaktion sollten also monetarisiert werden, indem Sie in die richtige Richtung gestupst werden (engl. Nudging), sodass Sie Ihre Meinung ändern, etwas kaufen oder mit größerer Wahrscheinlichkeit etwas tun. Dieser Einfluss auf Sie und Ihre Entscheidung ist der Wert, der für die Anbieter von Social Media-Plattformen monetarisiert werden kann.

Fake News sind Teil des Problems

Nichts ist langweiliger als Nachrichten, die nicht „aktivierend“ oder „kontrovers“ sind. Sogenannte „Click-bait“-Inhalte sind Inhalte, die aktiv versuchen, Regionen unseres Gehirns zu aktivieren, in denen die „Fear of missing out“ erzeugt wird. Diese Inhalte sind speziell so gestaltet, dass sie extrem klingen, super interessant oder super kontrovers sind, damit viele Leute darauf klicken. Dazu muss man auch wissen, dass Klicks so etwas wie der Goldstandard im Internet sind. Je mehr Aufmerksamkeit man bekommt, desto erfolgreicher wird das News-Outlet, der Influencer und die Plattform.

Aber die Jagd nach kontroversen Inhalten, die zu vielen Diskussionen, Shares und auch Interaktionen führen, ist auch eine Jagd nach vielen Fake News. Wir haben schon viele falsche Behauptungen gesehen, die viral gehen, wenn viele Menschen sie teilen und durch das Internet pushen, aber auf der anderen Seite schafft es die „langweilige Wahrheit“ kaum in die Top 10 der Leser.

Selbst Facebook, Google und andere Plattformen kämpfen (vermeindlich) hart, um Fake News zu erkennen und zu eliminieren. Die Wahrheit ist, dass sie sie auf ihrer Plattform haben wollen, weil das die Benutzerbindung und Interaktionsraten mit der Plattform erhöht.

Filterblasen (“ Filter Bubbles“) erklärt

Um zu verstehen, warum wir das Ziel solcher Inhalte sein können und warum wir auch manchmal nur ähnliche Inhalte sehen, müssen wir das Konzept einer „Filter Bubble“ verstehen. Dies ist ein gebräuchlicher Begriff, um eine Situation zu beschreiben, in der nur vorgefilterte Inhalte in Ihrem eigenen einzigartigen Informationsuniversum, in dem Sie online leben, präsentiert werden. Sie sehen also nur bestimmte Inhalte in Ihrer Timeline, für die Sie zuvor Interesse gezeigt haben oder mit denen Sie interagiert haben.

Ein einfaches Beispiel: Wenn Sie einige Tage hintereinander Heimwerkervideos auf Facebook ansehen, werden Sie plötzlich viele Heimwerkervideos, Inhalte und Seitenvorschläge in Ihrer Timeline sehen. Dafür werden andere Inhalte nach unten geschoben oder sogar aus Ihrer Inhaltsliste gelöscht. Social-Media-Plattformen versuchen, diese Filterblase perfekt zu optimieren, damit Sie länger im Internet bzw. auf der Plattform/App bleiben.

Hier ist nun das Problem. Stellen Sie sich vor, Sie sehen einen kontroversen Beitrag, in dem jemand Fake News veröffentlicht hat, und Sie versuchen einfach klarzustellen, dass dies falsch ist, und Sie teilen zum Beispiel eine zuverlässige Quelle. Dann denkt der Algorithmus, dass Sie diesen Inhalt mögen, weil Sie mit ihm interagiert haben. Am nächsten Tag sehen Sie zwei dieser Beiträge und am übernächsten Tag noch mehr. Plötzlich befinden Sie sich in einer Filterblase, in der Sie nicht sein wollen, und Sie fangen an, Nachrichten und sogar Beiträge auf eine voreingenommene Weise zu sehen, weil Sie plötzlich nur noch mit einer bestimmten Gruppe von Menschen interagieren.

Soziale Kluft – Vorurteile schaffen / ausnutzen

Wenn wir nur die gleichen Menschen mit den gleichen Überzeugungen sehen, fangen wir an, unbewusst zu denken, dass dies richtig ist. Das ist auch der Grund, warum Algorithmen nur weiße Menschen zu weißen Menschen präsentieren, Frauen zu Frauen, und deshalb wird man in seiner Welt voreingenommen.

Ein gutes Beispiel ist auch Instagram. Diese App ist einer der Vorreiter darin, den Benutzer-Feed auf deren Vorlieben zu optimieren. Wenn Sie große blonde Frauen mögen, werden Sie nur eine Welt voller großer blonder Frauen sehen. Wenn Sie nur nach Motivationszitaten suchen, wird Sie alles daran erinnern, erfolgreich zu werden und wie die Reichen ihr Leben leben. Dies bringt uns in viele Vorurteile und formt sogar, wie wir die Welt außerhalb der sozialen Medien sehen bzw. wie wir uns selbst wahrnehmen. Dies hat schon einige Menschen in die Depression bis hin zum Selbstmord getrieben.

Radikalisierung in der Politik

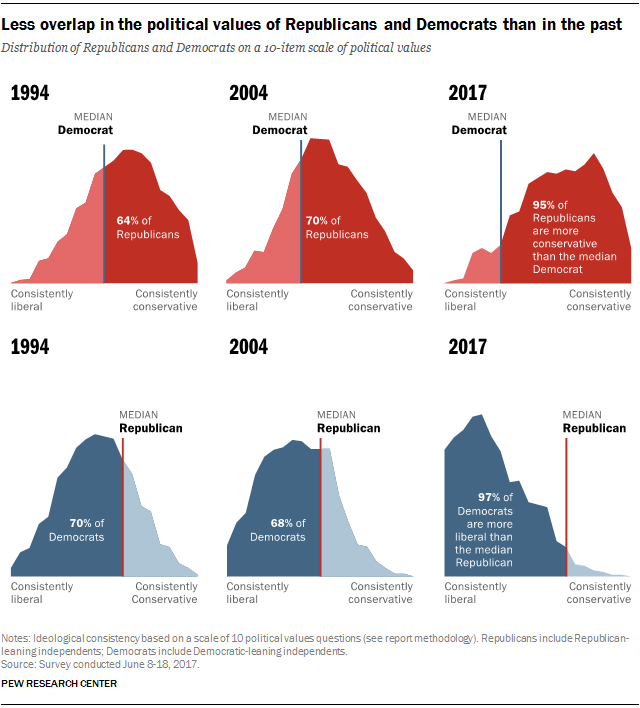

Ein gutes Beispiel im realen Leben ist immer die Politik, da sie weitgehend von Ihrer Umgebung und von den Informationen, die Sie konsumieren, beeinflusst wird. Jahrhundertelang war das Zweiparteiensystem der USA immer von beiden Parteien zur Mitte und zu liberalen Ideen geneigt. Das Pew Research Center hat in den Jahren 1994, 2004 und 2017 Umfragen durchgeführt und festgestellt, dass die liberale Sichtweise durch radikale Ansichten in den Top 10 der Politik ersetzt wird. Dies wird zu einem großen Teil auch auf die sozialen Medien und die Interaktion mit Inhalten in Filterblasen zurückgeführt.

Wenn man mit fake Nachrichten über stehlende, vergewaltigende und kriminelle Ausländer bombardiert wird, beginnt man zu glauben, dass Ausländer tatsächlich immer Kriminelle sind. Das führt zu einer radikaleren Sichtweise und letztlich zu einem radikaleren Wählermuster. (Natürlich gilt das Gleiche auch andersherum)

Wie entkommt man dieser Filterblase?

Es gibt einige Tricks, um einige Effekte Ihrer Filterblase zu beseitigen, um zumindest mehr Meinungen und abwechslungsreichere Inhalte in Ihren Feed zu bekommen.

- Menschen mit anderen Meinungen folgen

Suchen Sie aktiv nach Leuten, die nicht die gleiche Meinung haben und vielleicht etwas völlig anderes zu Ihrem Feed hinzufügen. Das hilft, eine abwechslungsreiche Sichtweise zu bekommen. - Durch Feeds anderer Personen scrollen

Suchen Sie einfach nach interessanten Leuten, von denen Sie noch nie gehört haben, und versuchen Sie, durch deren Feed zu scrollen, um verschiedene Meinungen zu sehen und zu erfahren, was diese „gefiltert“ bekommen. - Aktiv den Feed filtern

Bei jedem Artikel können Sie angeben, dass Sie weniger von diesen Vorschlägen sehen möchten. Normalerweise können Sie in den Post-Optionen (3-Punkte-Menü, etc.) sagen „Ich möchte weniger von diesem Inhalt sehen“. Dies wird Ihnen helfen, Ihren Content-Stream zu gestalten und vielleicht sogar mehr nützliche Inhalte in Ihren Stream zu bringen bzw. diesen aktiv zu beeinflussen.. - Selbst Nachforschungen machen

Es ist normalerweise schwer, echte Beweise zu finden. Aber wenn Sie das Gefühl haben, dass etwas nur zu Clickbait-Zwecken da ist, dann recherchieren Sie, ob es wirklich stimmt oder blockieren Sie es einfach, wie im Tipp zuvor erwähnt.

Fazit – Die Gefahren einer radikalen Welt

Wir sind an eine Welt gebunden, in der die sozialen Medien langsam unsere physischen sozialen Kontakte ersetzen. Wir haben noch nie so viele Inhalte konsumiert wie jetzt und wir müssen erkennen, dass wir ausgenutzt werden. Plattformen wie Facebook, Twitter und Co. versuchen, die Art und Weise zu optimieren, wie sie steuern, lenken und beeinflussen können, und wir müssen uns bewusst sein, dass dies geschieht, damit wir eine kleine Chance haben, gegenzusteuern.

Natürlich können wir nicht einfach alle Social-Media-Kanäle aufgeben, aber wir müssen eine ganz andere Herangehensweise beim Konsum dieser Dienste haben. Wir müssen uns bewusst sein, dass alles, was wir sehen, nur die perfekte „optimierte“ Content-Welt ist, dass wir ständig süchtig nach den Inhalten sind und so viel Zeit wie möglich damit verbringen, zu scrollen und neue Inhalte zu suchen. Diese Aufmerksamkeitsökonomie wird für immer da sein, denn die Büchse der Pandora wurde bereits geöffnet und wir müssen nur lernen, selbst damit umzugehen.

Ohne bestimmte politische Regulierungen und ohne Begrenzung unseres Medienkonsums als ganze Gesellschaft sind wir auf uns allein gestellt und entscheiden selbst, welche Inhalte wir konsumieren, wie lange wir interagieren und ob wir alles glauben, was uns online präsentiert wird.

Die Kommentarfunktion ist geschlossen.