Grundlagen des Data Mining – Ein (Prozess-)Überblick

Welche Prozesse gibt es beim Data Mining und wie kann man es verstehen?

Das Verständnis des Begriffs Data Mining ist in der Literatur sehr heterogen. Der folgende Artikel bietet einen kurzen Überblick zu den verschiedenen Prozessen des Data Mining sowie deren Inhalte.

Data Mining nutzt Verfahren der Statistik, der künstlichen Intelligenz sowie der Datenmustererkennung. Dabei wird in einer Datenmenge mit Hilfe von Kombinationen nach explizitem Wissen, das z. B. durch Aufdecken versteckter Zusammenhänge ermittelt wird, gesucht [1]. Das Ziel ist, Wissen („information-diamond“ [2]) durch aussagekräftige Muster aus großen Datenmengen automatisiert zu erhalten [3]. Um dieses Ziel zu erreichen, werden in der Literatur [4, 5, 6, 7] verschiedene Prozesse postuliert:

- Data Mining im KDD-Prozess

- Data Mining-Prozess nach SEMMA

- Data Mining-Prozess nach CRISP-DM

Diese drei Prozesse werden im Folgenden mit ihren verschiedenen Prozessschritten und Inhalten neutral betrachtet.

Index

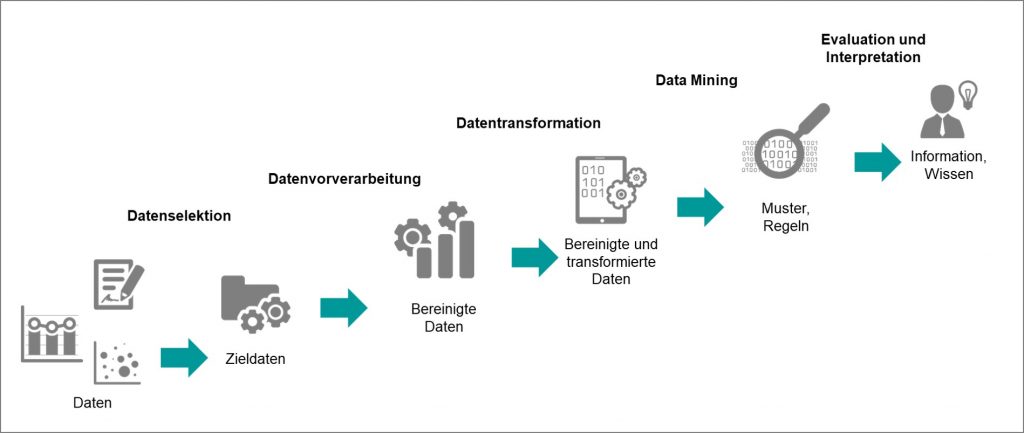

Data Mining im KDD-Prozess nach Fayyad

Der Begriff des Data Mining vereint auf der einen Seite verschiedene Verfahren im Prozess des Knowledge Discovery in Database (KDD) [5]. Der KDD wird oft als Gesamtprozess zur Generierung von Wissen mit einer starken Verbindung zur Datenbanktechnologie verstanden. KDD definiert Fayyad als nicht-trivialen Prozess, der valide, neuartige potenziell nützliche und schließlich verständliche Datenmuster identifiziert [5]. Der Prozess des KDD wird auch von Cios et al. [6] als KDP (Knowledge Discovery Process) beschrieben. Insgesamt enthält der KDD-Prozess verschiedene Phasen [4,5]:

Die verschiedenen Phasen des KDD werden im Folgenden zusammengefasst erläutert [2, 4, 5, 7, 8]:

Datenselektion

Geeignete Daten bzw. Datenmengen, die für die Aufgabenstellung relevant sind, werden aus dem Gesamtdatenbestand ausgewählt. Es können sowohl externe als auch interne Daten genutzt werden. Für die Weiterverarbeitung der ausgewählten Daten wird eine Datei mit einem Zieldatenbestand gespeichert. Somit fällt die Konzentration auf die reduzierte Datenmenge, bei der die Analyse durchgeführt werden soll.

Datenvorverarbeitung

Der Zieldatenbestand wird nun in der Vorverarbeitungsphase bereinigt. Ziel ist es, einen Datenbestand zu erhalten, der ausgewertet werden kann. Dazu muss die Datenqualität überprüft und gegebenenfalls verbessert werden. Fehlende Daten werden hinzugefügt und fehlerhafte oder widersprüchliche Daten korrigiert. Der bereits vorhandene Datenbestand kann in dieser Phase durch weitere Attribute angereichert werden, sofern es die jeweilige Aufgabenstellung erfordert. Die Kenntnis über die vorliegende Datenqualität ist für die weiteren Analyseschritte sowie deren Ergebnisse von hoher Bedeutung. Die Datenqualität beeinflusst die Robustheit der Analyseergebnisse signifikant.

Datentransformation

In der Phase der Datentransformation wird der Datenbestand in das vom Analyseverfahren geforderte adäquate Datenformat umgewandelt. Beispielhafte Transformationsschritte sind das Diskretisieren numerischer Werte, die Umwandlung nominaler in numerische Werte oder auch eine Gruppierung von metrischen Werten in Intervalle. Ziel ist es, die spezifischen Anforderungen des Analyseverfahrens an den auszuwertenden Datensatz zu erfüllen.

Data Mining

Das Data Mining stellt den Kernprozess des KDD für die Wissensgenerierung dar. Durch den Einsatz geeigneter mathematischer Methoden, die auf die Aufgabenstellung abgestimmt sind, wird nun das Modell entwickelt. Das Ziel des ausgewählten Verfahrens ist die Suche und das Auffinden von Datenmustern, die bisher unbekannt waren. Dazu muss das entsprechende Analyseverfahren ausgewählt werden.

Evaluation und Interpretation

Die Ergebnisse (Datenmuster) aus der Data Mining-Methode werden nun eingeschätzt und interpretiert. Durch diesen Prozessschritt entsteht bisher unbekanntes Wissen. Dieses Wissen muss bezüglich der Verwendbarkeit bewertet werden. Sofern die Aufgabenstellung anhand der gefundenen Muster nicht im definierten Maße erfüllt wird, können vorherige Prozessschritte wiederholt werden, um ein zufriedenstellendes Ergebnis zu erzielen. Die Muster werden nach dem Kriterium der Interessantheit beurteilt. Folgende Dimensionen sind dabei denkbar:

- Validität des Musters

- Neuartigkeit des generierten Wissens auf Basis der Muster

- Nützlichkeit des Musters

- Verständlichkeit der Aussage

Zusammenfassend soll durch diesen Prozess Wissen generiert werden, welches vorher noch nicht bekannt war. Der KDD-Prozess wird vorrangig in der Statistik, beim maschinellen Lernen sowie bei der Arbeit mit Datenbanksystemen angewendet [8]. Er ist dazu geeignet, „Informationen aus vorliegenden Daten zur Theorieentwicklung zu gewinnen“ [7].

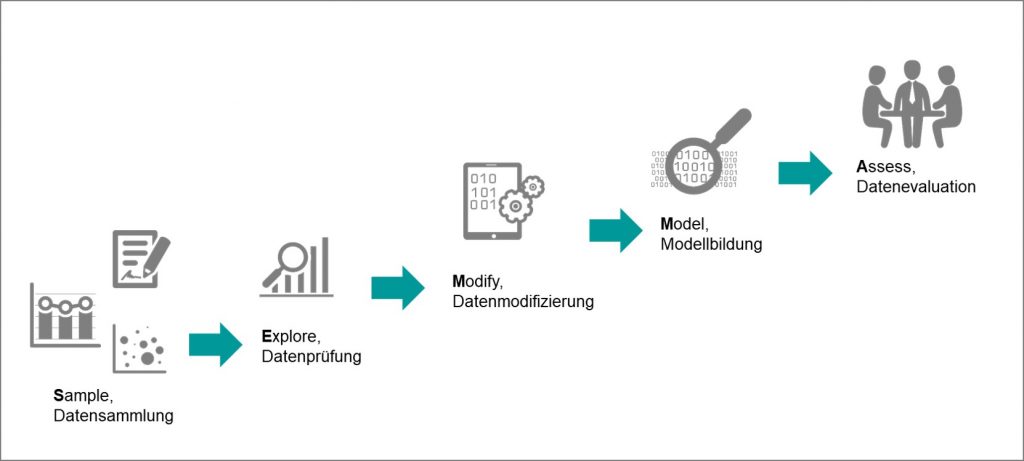

Data Mining-Prozess nach SEMMA

Synonym zum KDD wird mehrheitlich unter dem Begriff Data Mining der Gesamtprozess zur Generierung von explizitem Wissen verstanden [4]. Dieser Gesamtprozess wird im SEMMA-Modell von dem Unternehmen SAS Institute verwendet. SEMMA steht als Abkürzung für die folgenden Schritte im Prozess (Bild 2):

- Sample

- Explore

- Modify

- Model

- Assess

Zusammenfassend werden nun die einzelnen Prozessschritte kurz erläutert [4]:

Sample, Datensammlung

Relevante Daten werden zunächst aus dem Gesamtdatenbestand extrahiert. Somit wird ein Datenbestand zusammengestellt, der alle für die weiteren Auswertungen relevanten Informationen enthält.

Explore, Datenprüfung

Die extrahierten Daten werden auf Unregelmäßigkeiten im Bereich der Datenqualität untersucht. Somit wird die Datenqualität überprüft und ein größeres Datenverständnis erreicht.

Modify, Datenmodifizierung

Der ausgewählte Datenbestand wird auf das Analyseverfahren angepasst. Die Datentransformation ermöglicht, den Datensatz für das Analyseverfahren zu nutzen.

Model, Modellbildung

Die Daten werden je nach Analyseverfahren verarbeitet. Es wird mit Hilfe von Software nach Datenkombinationen gesucht, die zuverlässige Aussagen und Antworten für das Ausgangsproblem generieren.

Assess, Datenevaluation

Die Ergebnisse aus dem Analyseverfahren werden evaluiert. Die Nützlichkeit und Zuverlässigkeit der gewonnenen Aussagen werden überprüft.

Obwohl der SEMMA-Prozess und die entsprechende SAS-Software zunächst unabhängig voneinander sind, werden beide miteinander verbunden. Dabei müssen nicht alle Data Mining-Phasen in der Software genutzt werden. Je nach Bedarf können einzelne Schritte ausgeblendet werden. Aber auch beim SEMMA-Prozess sollte iterativ vorgegangen werden. Für ein robustes Ergebnis ist es sinnvoll, verschiedene Phasen zu wiederholen. Eine valide Datengrundlage ist für den gesamten Prozess zwingend.

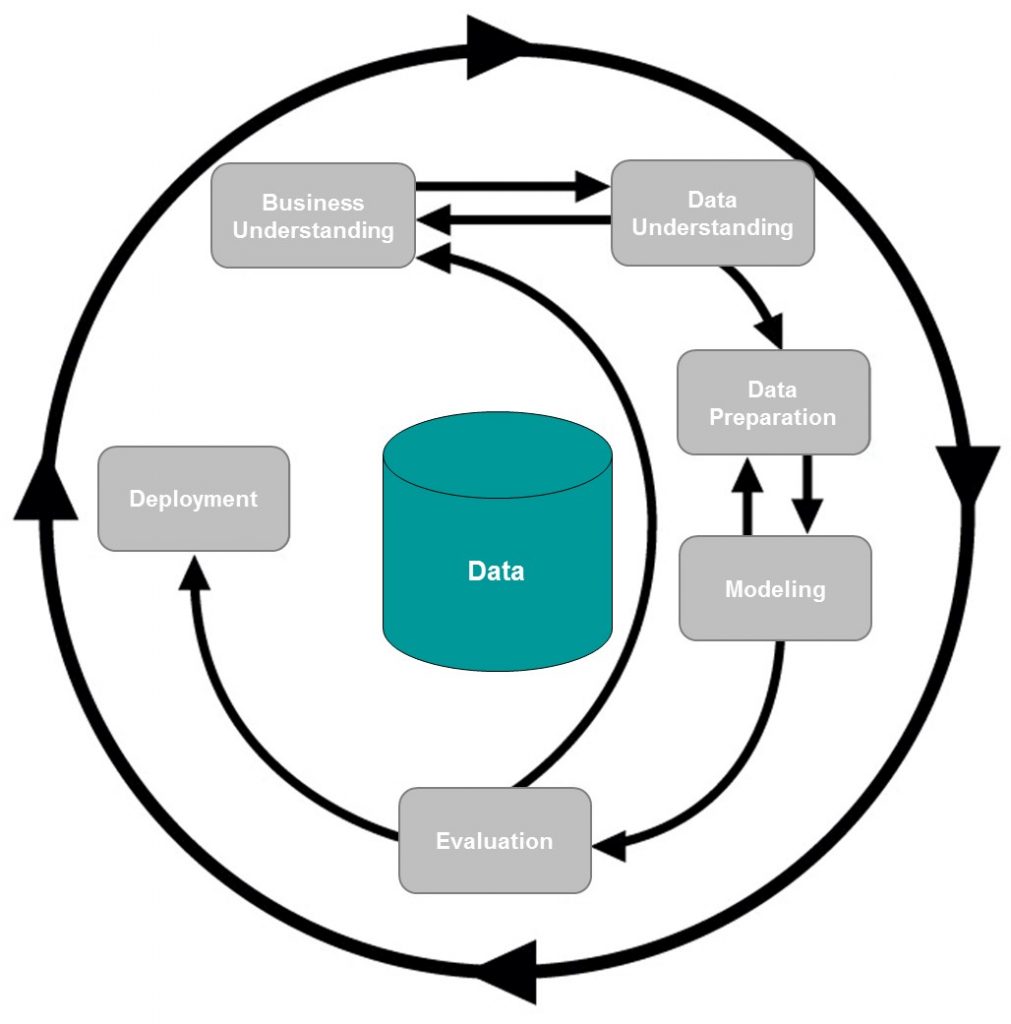

Data Mining-Prozess nach CRISP-DM

Eine weitere Möglichkeit zur Modellierung eines Data Mining-Prozesses bildet das CRISP-DM-Modell mit seinen sechs idealtypischen Phasen [7]. Dieses Modell ist durch einen Zusammenschluss verschiedener Unternehmen erarbeitet worden [6]. Das Akronym CRISP-DM bedeutet aufgeschlüsselt folgendes:

- Cross

- Industry

- Standard

- Process for

- Data Mining

Das Ziel dieses standardisierten Prozesses ist die Validierung der berechneten Ergebnisse [4]. Dabei werden die folgenden Phasen unterschieden (Bild 3).

Business Understanding, Aufgabendefinition

Die erste Phase stellt die Basis des CRISP-DM dar. Die Phase beinhaltet folgende Aspekte:

- Definition der Problemstellung

- Situationsbewertung

- Festlegung der Data Mining-Ziele

- Anfertigung des Projektplans

Die betriebswirtschaftliche Betrachtungsweise bei der Aufgabendefinition stellt sicher, dass der Data Mining-Prozess der Verbesserung von Betriebsabläufen bzw. der Reduzierung von Prozesskosten dient. Operationale Zielkriterien müssen aus betriebswirtschaftlicher Perspektive definiert sowie Gestaltungs- bzw. Handlungsalternativen dargelegt werden.

Data Understanding, Datenauswahl

Die Datenauswahl umfasst primär die Auseinandersetzung mit den Daten des Unternehmens, die schon vorhanden sind oder die noch extern beschafft werden müssen. In der Data Understanding-Phase werden folgende Punkte bearbeitet:

- Katalogisierung und Beschaffung der Ursprungsdaten

- Beschreibung der Daten

- Exploration bzw. Visualisierung der Daten

- Überprüfung der Datenqualität

Die Katalogisierung und Beschaffung der Daten hat zwei Ziele: Einerseits soll eine Übersicht geschaffen werden, die zeigt, welche Quellen für die Daten genutzt werden können. Andererseits soll der Zugang zu den möglichen Daten hergestellt werden, sodass diese im Falle einer angestrebten Verwendung kurzfristig abgefragt werden können. Der nächste Schritt beinhaltet die Beschreibung der relevanten Daten. Der Fokus liegt auf dem Datenformat, der Datenmenge (Anzahl der Merkmale und Anzahl der Attribute) und der Bedeutung der Attribute. Das Ergebnis der Datenbeschreibung muss sich mit den Anforderungen an die Daten aus der ersten Phase (Business Understanding) decken. Nach der Datenbeschreibung folgt die Datenexploration. Diese dient dazu, die Daten besser kennenzulernen. Dazu werden OLAP-Abfragen eingesetzt, die zu einem deskriptiven Output in Form einer Tabelle führen. Dieser Vorgang wird durchgeführt, um mögliche Unregelmäßigkeiten innerhalb der Datenqualität zu identifizieren. Dieser Teilprozessschritt zielt primär auf die Begutachtung der Vollständigkeit der Daten ab. Für die relevanten Attribute sollte die Menge an fehlenden Werten auf ein Minimum reduziert sein.

Data Preparation, Datenaufbereitung

Die Datenaufbereitung beinhaltet alle Handlungen zur Generierung einer Datenmenge, die den Data Mining-Verfahren als Input dient. Dabei werden folgende Aufgaben erfüllt:

- Auswahl der Daten

- Bereinigung der Daten

- Konstruktion der Daten

- Integration der Daten

- Formatierung der Daten

Innerhalb der Auswahl der Daten ist es möglich, vorab einige der Attribute zu vernachlässigen, sofern diese eine nicht ausreichende Datenqualität vorweisen. Im Anschluss werden die Daten bereinigt. Innerhalb der Datenbereinigung wird die Entscheidung getroffen, wie mit fehlerhaften oder fehlenden Daten, die für eine exakte Analyse unbedingt notwendig sind, weiter verfahren wird. Fehlende Datensätze sind mittels Schätzverfahren anzunehmen. Falls dies nicht umsetzbar ist, sind gegebenenfalls Stichproben aus den Datensätzen, die vollständig zur Verfügung stehen, verwendbar. Somit werden neue Datensätze konstruiert. Durch die nachfolgende Datenintegration werden relationale Datenbankstrukturen in eine Tabelle mit Daten übertragen. Die Zeilen bilden die Datensätze und die Spalten die Merkmale bzw. Attribute ab. Abschließend wird in diesem Prozessschritt das Datenformat untersucht. Gegebenenfalls muss das Datenformat, wie z. B. die Zeichenlänge, an den Algorithmus angepasst werden.

Modeling, Auswahl und Anwendung von Data Mining-Verfahren

Die Modeling Phase beschreibt die eigentliche Anwendung der Data Mining-Verfahren. Es werden unterschiedliche Algorithmen verwendet, um die definierte Aufgabenstellung zu lösen. Die verschiedenen Algorithmen haben unterschiedliche Anforderungen an die Datensätze. Ein iterativer Vorgang, der das Datenformat mit dem Analyseverfahren abgleicht, ist unumgänglich. Folgende Aufgaben sind in dieser Prozessphase enthalten:

- Auswahl der Algorithmen

- Erzeugung der Trainings- und Testdaten

- Aufbau des Modells

- Bewertung des Modells (technische Sichtweise)

Die Aufgabendefinition legt fest, welcher Algorithmus verwendet werden soll. Die Daten, die zuvor in der Data Preparation-Phase aufbereitet worden sind, werden in Trainings- und Testdaten differenziert. Anhand des Trainingsdatenbestandes wird das Modell erlernt. Dagegen wird die Modellgüte auf einem disjunkten Testdatenbestand von den Testdaten bestimmt. Wenn anschließend die Test- und Trainingsdaten vorhanden sind, folgt die Anwendung des Modells, indem die Algorithmen durchgeführt werden. Zum Abschluss ist noch die technische Modellbewertung durchzuführen.

Evaluation, Bewertung und Interpretation der Ergebnisse

Die Ergebnisse des Analyseprozesses werden interpretiert und bewertet. Die Phase Evaluation befasst sich hauptsächlich mit einem Vergleich des Soll- und Ist-Zustands bezüglich der Aufgabendefinition und Ziele aus betriebswirtschaftlicher Sicht. Folgende Gesichtspunkte werden in der Evaluationsphase genauer betrachtet:

- Bewertung der Ergebnisse (betriebswirtschaftliche Sichtweise)

- Prozessrückblick

- Maßnahmendefinition

Bei der Bewertung des Ergebnisses könnte eine Kosten-Nutzen-Analyse für das komplette Data Mining-Projekt durchgeführt werden, um der betriebswirtschaftlichen Reflexion gerecht zu werden. Weitere Punkte, die in die Ergebnisbewertung einfließen sind beispielsweise die Vollständigkeit und Übersichtlichkeit der Ergebnisdarstellung oder auch der Neuigkeitsgehalt und die Nützlichkeit der Ergebnisse. Der Prozessrückblick beinhaltet danach eine Prüfung, ob der Kern der Aufgaben im Data Mining-Prozess bis zu diesem Zeitpunkt abgearbeitet worden ist. Final werden auf Basis der Analyseergebnisse Maßnahmen definiert.

Deployment, Anwendung der Ergebnisse

Die letzte Phase im CRISP-DM-Prozess umfasst die Anwendung und Umsetzung der Analyseergebnisse. Diese enthält folgende Punkte:

- Umsetzungsplanung

- Überwachung der Planung

- Erzeugung des Abschlussberichts

- Projektrückblick

Mit der Umsetzungsplanung definierter Maßnahmen soll eine strukturierte Vorgehensweise sicherstellt werden. Dabei sind Aspekte des Projektmanagements zu beachten. Für eine zielführende Durchführung der Maßnahmen ist eine Kontrollfunktion bezüglich des Fortschritts der definierten Maßnahme zu installieren. Zum Schluss des Data Mining-Prozesses ist ein Abschlussbericht anzufertigen. Dieser sollte lediglich die wichtigsten Zahlen, Daten und Fakten beinhalten. Der Projektrückblick dient der kontinuierlichen Verbesserung des Data Mining-Prozesses. Dazu ist es wichtig, die Ergebnisse des abgeschlossenen Prozesses kritisch zu würdigen und gegebenenfalls aufgetretene Probleme und Auffälligkeiten zu verbessen bzw. zukünftig zu vermeiden.

Einsetzen der Data Mining Prozesse

Mit Hilfe von Data Mining als Teil des Wissensmanagements kann der Aufwand des Sammelns und des (teilweise) manuellen Auswerten von Daten durch die automatisierte Wissensgenerierung gesenkt werden. Große Datenmengen aus verschiedenen Datenquellen werden durch statistische Verfahren analysiert. Das Data Mining vereint dabei verschiedene Disziplinen, die in einer engen Verbindung zueinanderstehen:

- Mathematik

- Statistik

- Datenbanken

- Business Intelligence

- (Computer-)Visualisierung

- Expertensysteme

Der Prozess des KDD wird in der Wissenschaft genutzt, wohingegen die Prozesse des CRISP-DM und SEMMA in der Industrie verwendet werden [10]. Weitere Anwendungsgebiete des Data Mining sind unter anderem:

- Lieferantenmanagement

- Medizin

- Ingenieurswesen

- Produktion

- Marketing

- Vertrieb

Quellen

[1] Heinrich, L. J.; Stelzer, D.: Informationsmanagement. München: Oldenbourg, 2009.

[2] Adriaans, P.; Zantinge, D.: Data Mining. Harlow: Addison-Wesley, 1998.

[3] Hippner, H.; Wilde, K. D.: Data Mining im CRM. In: Effektives Customer Relationship Management. Hrsg.: Helmke, S.; Uebel, M.; Dangelmaier, W. Wiesbaden: Springer Gabler, 2017, S. 142–159.

[4] Cleve, J.; Lämmel, U.: Data Mining. Berlin: De Gruyter, 2016.

[5] Fayyad, U. M. (Hrsg.): Advances in Knowledge Discovery and Data Mining. Menlo Park: AAAI Press, 1996.

[6] Cios, K. J.; Pedrycz, W.; Swiniarski, R. W.; Kurgan, L. A.: Data Mining. Boston MA: Springer, 2007.

[7] Gabriel, R.; Gluchowski, P.; Pastwa, A.: Data Warehouse und Data Mining. Witten: W3L, 2009.

[8] Ester, M.; Sander, J.: Knowledge Discovery in Databases. Berlin, Heidelberg: Springer, 2000.

[9] IBM Corporation: IBM SPSS Modeler CRISP-DM Guide. URL: https://www.ibm.com/support/knowledgecenter/en/SS3RA7_15.0.0/com.ibm.spss.crispdm.help/crisp_overview.htm (Zugriff: 2017-06-27).

[10] Harding, J. A.; Shahbaz, M.; Srinivas; Kusiak, A.: Data Mining in Manufacturing. J. Manuf. Sci. Eng. Jg. 128 (2006) Nr. 4, S. 969–976.

Die Kommentarfunktion ist geschlossen.