Machine Learning – Grundlagen und Definition für Anfänger und Manager erklärt

Wir erklären euch die Grundlagen von Machine Learning und warum es so wichtig ist.

Um selbst einschätzen zu können, welche Potenziale Machine Learning für das eigene Geschäft bietet, muss die Organisation zunächst technische Begriffe korrekt verwenden. Dieser Artikel erklärt „Machine Learning“ allgemein verständlich und jenseits des Hypes.

Index

Ist Machine Learning wirklich neu?

Machine Learning (im Folgenden ML genannt) ist eine Teildisziplin der künstlichen Intelligenz und ist bereits seit über 50 Jahren Gegenstand der Forschung. Damit ist ML nicht neu. Allerdings ist es nach der „Entdeckung“ ziemlich schnell in Vergessenheit geraten, weil sich nach ersten Anfangserfolgen schnell Ernüchterung breitgemacht hat. Die richtigen Anwendungsfälle konnten einfach nicht gefunden werden und Daten standen auch nicht in der notwendigen Menge und Qualität zur Verfügung.

Wenn ML nicht neu ist – Warum wird es gerade so gehypt?

Selbstverständlich konnten die ML-Algorithmen in den letzten 50 Jahren stark verbessert werden. Trotzdem ist das nicht der Hauptgrund für den Trend, diese Algorithmen nun in die Praxis zu bringen.

Bedingt durch die sprunghaft angestiegene (und für jeden verfügbare) Rechenkapazität ist es jetzt wirtschaftlich möglich, die dafür benötigen enormen Rechenkapazitäten aufzubringen. Durch schnelle Grafikkarten stehen heute Server für wenige Euro pro Stunde zur Verfügung, die vor wenigen Jahren noch auf der Supercomputer-Liste ganz oben gestanden hätten (und damit unbezahlbar gewesen wären).

Parallel dazu sind auch die zur Verfügung stehenden Datenmengen gewachsen – das betrifft eigene Unternehmensdaten genau wie öffentliche Daten. Dadurch steht eine exzellente Grundlage zur Verfügung, um damit wirklich sinnvolle und nützliche Anwendungsfälle für Unternehmen abzubilden. Dazu gehören z.B. die Predictive Maintenance (d.h. Abschätzung des Ausfallzeitpunkts), Erkennung von gesprochenen Texten und Preisprognosen.

Auch wenn sich momentan ein Hype daraus entwickelt, dem sicher (wieder) eine große Ernüchterung folgen wird, können sehr viele Geschäftsmodelle davon profitieren bzw. damit sogar strategisch weiterentwickelt werden.

Machine Learning jenseits des Hypes verstehen

Was ist ein Algorithmus?

Einen Algorithmus für Computer kann man sich wie ein Kochrezept vorstellen. Darin ist genau beschrieben, welche Schritte nacheinander durchgeführt werden. Computer verstehen keine Kochrezepte, sondern Programmiersprachen: Darin wird der Algorithmus in formale Schritte (Befehle) zerlegt, die für den Computer verständlich sind.

Manche Probleme lassen sich leicht als Algorithmus formulieren, z.B. das Zählen von 1 bis 100 oder die Überprüfung, ob eine Zahl eine Primzahl ist. Bei anderen Problemen ist das sehr schwierig, z.B. bei der Erkennung von Schrift oder der Verschlagwortung von Text. Hier helfen die Verfahren des Maschinellen Lernens. Schon lange hat man sich dazu Algorithmen ausgedacht, die es ermöglichen, bestehenden Daten zu analysieren und das daraus abgeleitete Wissen auf neuen Daten anzuwenden.

Warum nennt man manche Algorithmen „lernend“?

Ein Machine Learning Algorithmus hat sehr viele Freiheiten, die sog. Parameter. Vereinfacht könnte ein Parameter zum Beispiel dazu verwendet werden, Nachrichten mit dem Wort „Trump“ geografisch in den Bezug zur Region Nordamerika zu bringen. Typischerweise nutzen ML-Algorithmen viele hunderte, oft auch bis zu hunderttausend Parameter. Das Justieren der Parameter, damit sich möglichst die richtigen Ergebnisse für die bestehenden Daten ergeben, wird als Lernvorgang bezeichnet.

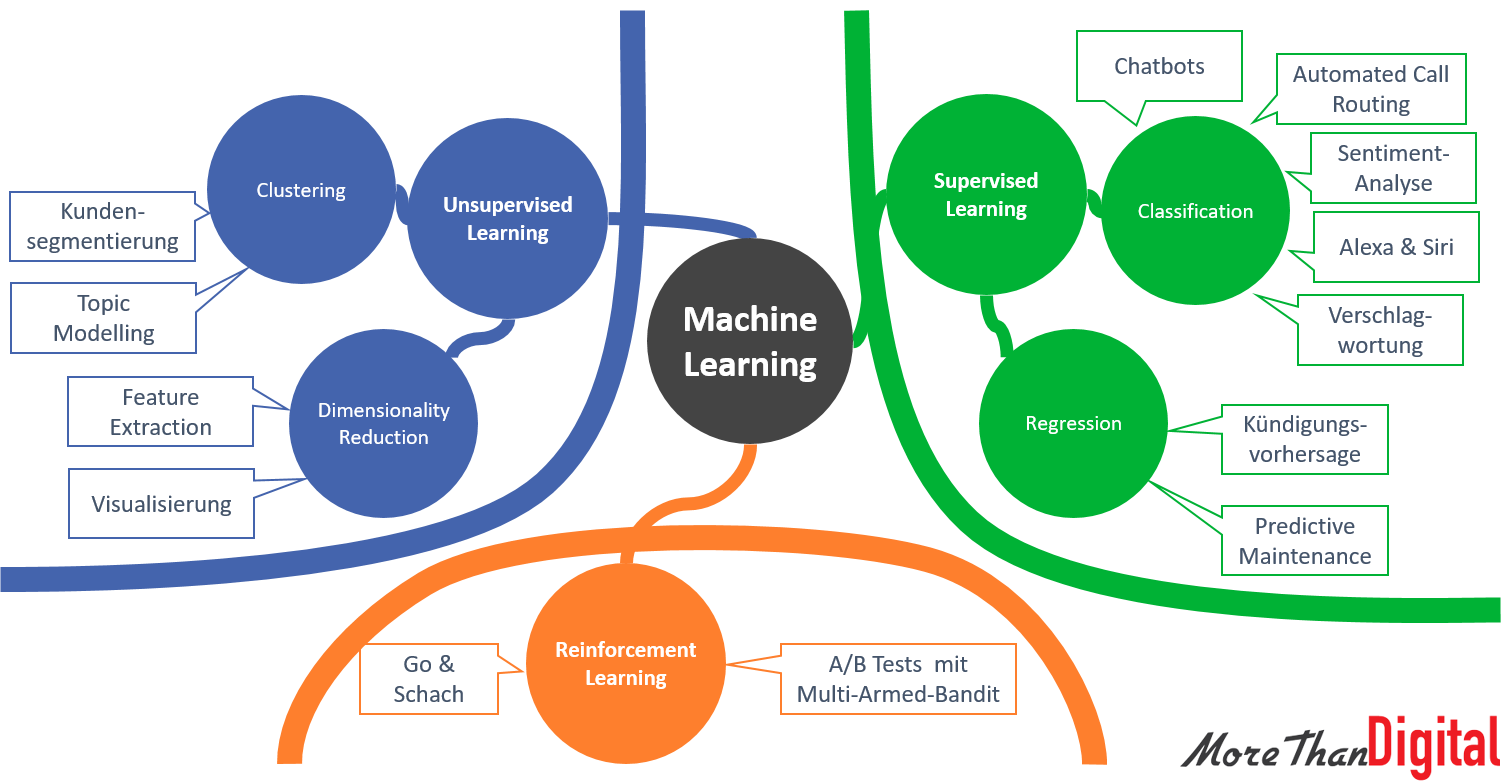

Landkarte über die unterschiedlichen Machine Learning Verfahren

Die folgende Landkarte zeigt eine Übersicht der unterschiedlichen Machine Learning Verfahren und konkreter Anwendungen, die aktuell besonders viel Anklang in der Wirtschaft finden. Zusammen mit dem anschließenden erklärenden Text kann diese Grafik Organisationen dazu dienen, sich dem Thema Machine Learning mit Faktenwissen anzunähern und das Potenzial für ihr eigenes Geschäft zu identifizieren.

Supervised Learning – Was ist das?

Für das sogenannte „überwachte Lernen“ werden bekannte Daten benötigt, die bereits die Logik beinhalten, die man gerne auf ein neues Datenset anwenden möchte.

Aus diesen Daten wird ein Trainings- und Testdatenset ausgewählt. Ersteres dient dazu, die Parameter im Algorithmus entsprechend einzustellen, während letzteres gebraucht wird, um die Performance des Algorithmus zu evaluieren. Hier kann man beispielsweise auch Qualitätsmetriken berechnen und den Trainingsprozess beenden, wenn die Ergebnisse als gut genug betrachtet werden (das kann unter Umständen lange dauern oder gar nicht passieren!).

Der Algorithmus lernt die Logik innerhalb dieses sogenannten Trainingssets. Ein so trainierter Algorithmus kann anschließend Daten, die eine bestimmte Ähnlichkeit zu dem Trainingsset aufweisen, mit der gelernten Logik klassifizieren – zum Beispiel anhand der vorgegebenen Kategorien Produkt gekauft/nicht gekauft oder Kündigung/Keine Kündigung.

Man muss bei einigen Schritten sehr gut aufpassen: So darf zum Beispiel der Algorithmus, wenn er mit einer Trainingsmenge übt, nicht einfach alles „auswendig“ lernen, sondern muss die dahinterliegende Logik begreifen. Schafft man das nicht, heißt das Problem, vor dem man steht „Overfitting“.

Unsupervised Learning – Was ist das?

Das unüberwachte Lernen eignet sich, wenn keine bekannten, logisch gegliederten Daten zum Üben für das überwachte Lernen zur Verfügung stehen. Algorithmen, die unüberwachtes Lernen anwenden, können zum Beispiel eine Kundendatenbasis nach unterschiedlichen Kundengruppen gliedern (Kundensegmentierung). Dabei gibt es Algorithmen, die selbst entscheiden wie viele solcher Cluster sie bilden und Algorithmen, denen man die Anzahl der Cluster vorgibt.

Auch nach dieser Art des Maschinellen Lernens folgt wieder die manuelle Arbeit und menschliche Kreativität wird zur Interpretation des Ergebnisses benötigt: Denn die gefundenen Cluster müssen nun fachlich interpretiert werden. Der Algorithmus liefert nämlich keine Begründung, warum diese Cluster so entstanden sind.

Eine weitere Möglichkeit des unüberwachten Lernens ist die sogenannte Dimensionsreduktion. Dies kann verwendet werden, um aus einer existierenden Datenmenge sog. Features herauszufinden, d.h. Komponenten, in denen sich die Daten tatsächlich unterscheiden. Ein Beispiel dafür könnten Beschreibungen von Kleidungsstücken sein, als Feature würde dann die Farbe extrahiert.

Reinforcement Learning – Was ist das?

Eine in der Wirtschaft aktuell etwas weniger bedeutende Art des Lernens ist das Reinforcement Learning, dabei handelt es sich auch um ein überwachtes Verfahren. Die Idee dabei ist, erfolgreiches Verhalten zu belohnen (und damit zu fördern), während das Verhalten unterdrückt wird, das zu unerwünschten Ergebnissen geführt hat.

Will man zum Beispiel einen Algorithmus darauf trainieren, an zehn einarmigen Banditen (die unterschiedlich „gut“ funktionieren) um Geld zu spielen, so würde man zunächst fünf Mal an jedem Automaten spielen lassen und dann häufiger bei den Automaten, die bei der ersten Probe die höchsten Gewinne geliefert haben. Ein wenig darf der Algorithmus auch noch bei den Automaten spielen, die wenig oder gar keine Gewinne geliefert haben, denn das könnte ja bei den ersten fünf Versuchen auch ein ungünstiger (und unwahrscheinlicher) Zufall gewesen sein und in Wirklichkeit sind das die besten Automaten.

Wie viele Algorithmen, die lernen können, gibt es?

Es gibt eine Vielzahl unterschiedlicher lernender Verfahren, genannt seien hier nur Support Vector Machines und Decision Trees als Repräsentanten des überwachten Lernens.

Für jedes dieser Verfahren gibt es unterschiedliche Algorithmen, wie die Parameter justiert werden, um eine möglichst hohe Übereinstimmung mit den bekannten Daten zu erzielen. Diese Algorithmen sind die eigentlichen Lernverfahren beim Machine Learning. Beispiele dafür sind Gradient Descent, Backpropagation und Genetic Algorithms.

Je nach Anwendungszweck zeigt es sich, dass bestimmte Algorithmen besser oder weniger gut funktionieren. Das kann außerdem durch die Daten beeinflusst werden. Einige spezielle Anwendungsfälle erfordern gar Modifikationen an den Algorithmen selbst. Für sehr viele Fälle kann man mit Standard-Algorithmen schon sehr gute Ergebnisse erreichen. In Einzelfällen kann sich jedoch die Notwendigkeit ergeben, einen Algorithmus zu modifizieren oder einen eigenen zu entwickeln.

Machine Learning bedeutet zuerst immer noch: Manuelle Arbeit

So automatisiert sich das alles anhört, beinhalten die Prozesse des Machine Learnings immer noch viele manuelle Prozessschritte: Zum Beispiel stehen bekannte Daten oft nicht in der Qualität zur Verfügung, in der man sie eigentlich benötigt. Daher müssen die Daten im ersten Schritt meist bereinigt werden, im Rahmen des sogenannten Data Cleansing.

ML ist ein statistisches Verfahren

Alle drei Arten des Machine Learnings sind statistische Verfahren, das heißt, dass erst eine hohe Anzahl von Wiederholungen zu guten Ergebnissen führt. Diese „stupide“ Arbeit können Computer sehr gut erledigen und durch die stark gewachsene Rechenkapazität müssen wir auch nicht mehr sehr lange auf die Ergebnisse warten.

Hinter einem erfolgreichen Machine Learning Projekt steht immer ein interdisziplinäres Team

ML macht Produkte und Services nutzerfreundlicher, Prozesse effizienter und Vorhersagen verlässlicher. Definiert die Unternehmensführung die Nutzung von Machine Learning als Teil der Unternehmensstrategie, hat Machine Learning – mit den richtigen Daten kombiniert – die Macht, das komplette Geschäftsmodell zu revolutionieren.

Vor diesem Hintergrund ist der aktuelle Hype, der sich um ML entwickelt hat, sehr gut verständlich.

Bei all den Möglichkeiten darf man nicht vergessen: ML ist kein Allheilmittel. Entscheidend ist die Datenqualität, also das „Futter“ von ML: So gilt „Garbage in – garbage out“ insbesondere für ML. Zudem benötigt ML sehr große Datenmengen, die nicht immer vorhanden sind.

Die Ergebnisse, die der ML Algorithmus erzeugt, sind immer nur so gut, wie die Menschen, die mit unternehmensrelevanten Fragestellungen im Kopf passende Datenmengen beschafft und vorbereitet haben und die Parameter des Algorithmus so lange immer wieder angepasst haben, bis ein fachliches interpretierbares Ergebnis zustande kam.

Dabei gibt in vielen Fällen nicht die Technik die Grenzen des ML vor, sondern die Kreativität der Menschen. Es ist essenziell, den für das Geschäft passenden Use Case zu finden und diesen dann iterativ, mit all dem vorhandenen Domänenwissen, das die eigenen Mitarbeiter mitbringen, auszugestalten. Kundenzentrierte Innovationsmethoden wie Design Thinking und Lean Prototyping-Ansätze leisten dazu einen wichtigen Beitrag – auch indem man ein Scheitern früh bemerkt.

Die Kommentarfunktion ist geschlossen.